با توجه به محبوبیت چشمگیر هوش مصنوعی در ماههای اخیر، 2023، سال مهمی برای شرکتهای فعال در این حوزه خواهد بود.

افزایش انتشار اپلیکیشنهای خلق آثار هنری با هوش مصنوعی یکی از مهمترین اتفاقات مورد انتظار در حوزه هوش مصنوعی در سال ۲۰۲۳ است. درضمن مقابله با استفاده از آثار هنری هنرمندان برای آموزش سیستمهای هوش مصنوعی نیز در سال میلادی جاری دور از انتظار نیست. امکان تغییر رویکرد شرکتها در سال ۲۰۲۳ در راستای تبعیت از قوانین جدید مرتبط با هوش مصنوعی نیز وجود دارد. احتمالاً در ماههای آینده شاهد جذب سرمایههای قابلتوجهی در این حوزه خواهیم بود.

هوش مصنوعی هم مانند هر فناوری دیگری مزایا و معایب خود را دارد. این فناوری هم میتواند باعث ترس و وحشت شود و هم میتواند امید و روشنی بیافریند. در این مطلب قصد داریم مهمترین اتفاقات مورد انتظار در حوزه هوش مصنوعی در ماههای آتی ۲۰۲۳ را بیان کنیم.

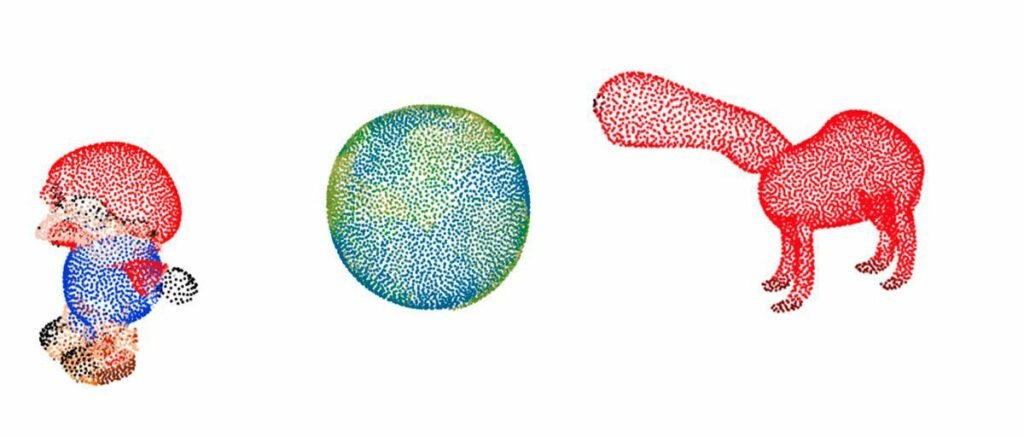

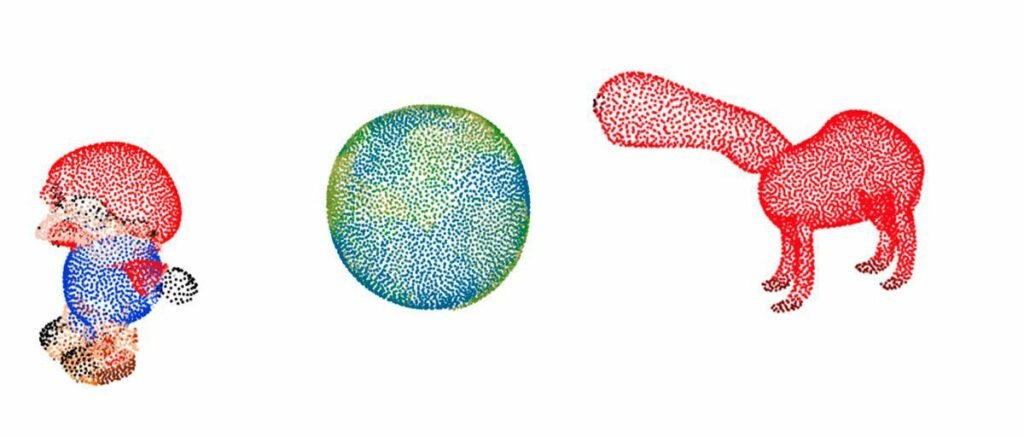

مدلهای هوش مصنوعی خالق آثار هنری، با خلاقیت سرشار خود باعث ایجاد اپلیکیشنهای متعدد ساخت عکس و حتی ایجاد مدلهای تجاری شدهاند. Stable Diffusion (استیبل دیفیوژن) که تابستان ۲۰۲۲ منتشر شد، یکی از این مدلهاست.

نمونه آثار خلقشده توسط مدل هوش مصنوعی Stable Diffusion

از سوی دیگر، ماهیت متنباز این مدلها باعث شد آنها ابزار دست جاعلان برای ساخت تصاویر دیپ فیک شوند. درضمن راهاندازی Stable Diffusion، اعتراضات هنرمندان دیجیتالی در مورد کاهش درآمدشان را نیز بهدنبال داشت.

به نظر شما در سال ۲۰۲۳ شاهد چه اتفاقاتی در حوزه هوش مصنوعی خواهیم بود؟ آیا قوانین میتوانند بدترین پیامدهای رشد تواناییهای هوش مصنوعی را مهار کنند؟ آیا اشکال جدید متحولکننده هوش مصنوعی مثل چت بات هوش مصنوعی ChatGPT (چت جیپیتی) میتوانند بخشهایی را که زمانی بهنظر میرسید در برابر عواقب بد توسعه هوش مصنوعی مصون باقی خواهند مانند، کاملاً تحت سلطه خود قرار دهند؟

چتبات هوش مصنوعی ChatGPT

افزایش اپلیکیشنهای خلق آثار هنری با هوش مصنوعی

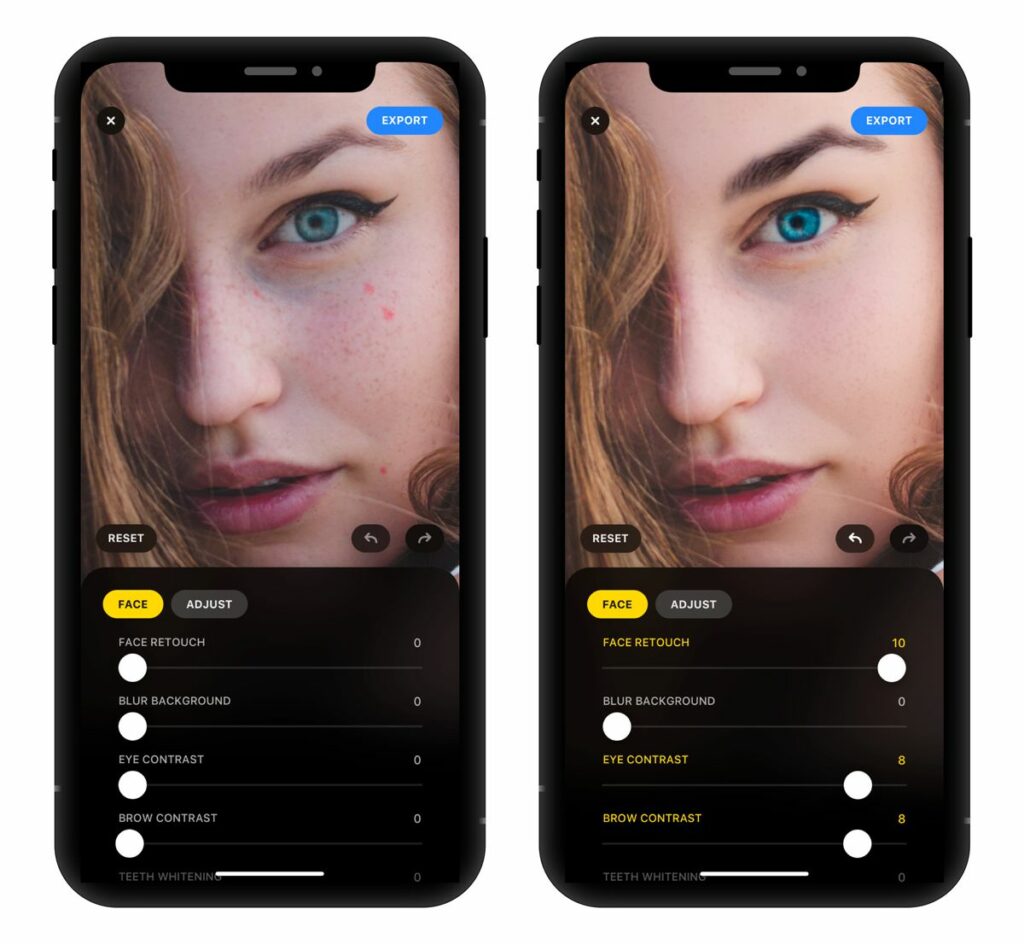

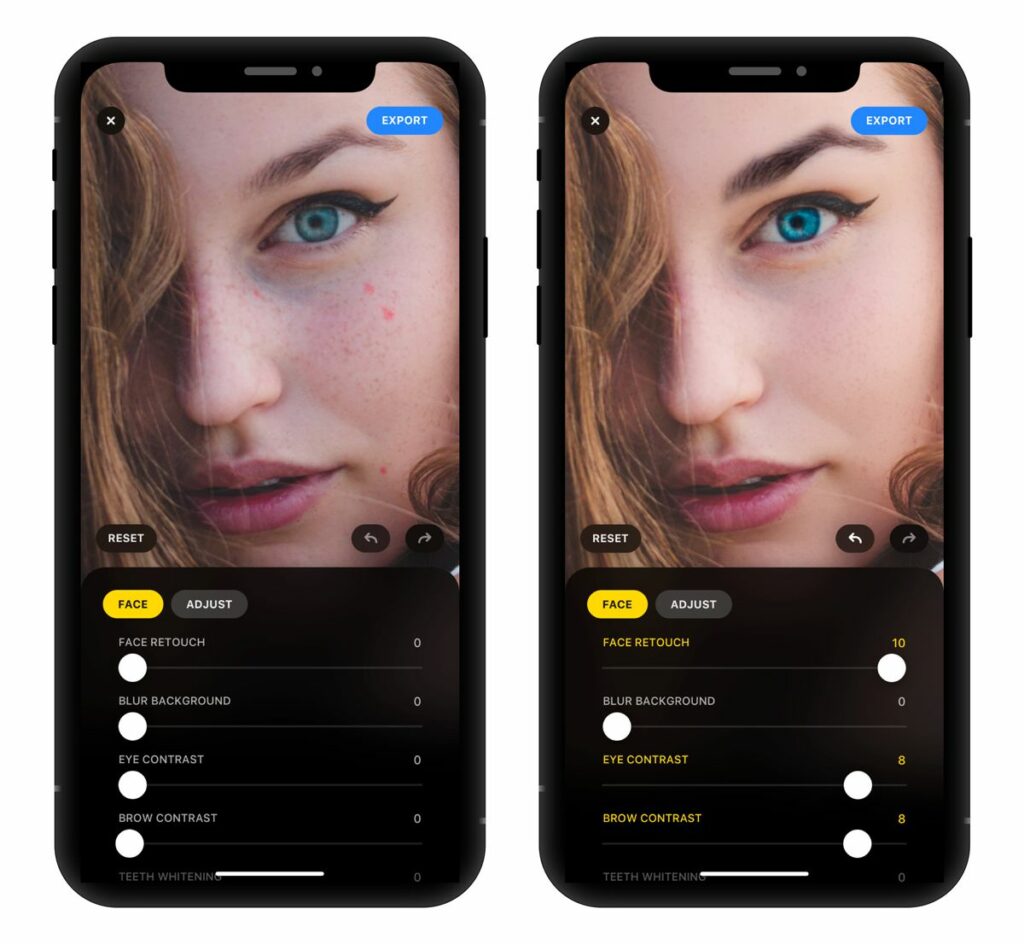

لنزا (lensa)، اپلیکیشن موبایل برای گرفتن عکسهای سلفی و ویرایش آنها، محصول شرکت پریزما لبز (Prisma Labs)، در سال ۲۰۲۲ موفقیت و محبوبیت زیادی را بهدست آورد. با توجه به موفقیت این اپلیکیشن انتظار میرود سال ۲۰۲۳ شاهد انتشار تعداد زیادی از اپلیکیشنهای مشابه از سوی شرکتهای فعال در اینحوزه باشیم.

اپلیکیشن موبایل هوش مصنوعی لنزا برای گرفتن تصاویر سلفی و ویرایش آنها

البته متأسفانه ممکن است تصاویر خروجی چنین اپلیکیشنهایی، از نظر اخلاقی نامناسب باشد. حتی ممکن است این اپلیکیشنها برای ایجاد جذابیت جنسی در تصاویر زنان، ظاهر چنین تصاویری را بهشکل نامناسبی تغییر دهند.

نمونه آثار هنری خلقشده با هوش مصنوعی زایا

بهنظر ماکسیمیلیان گانتز (Maximilian Gahntz)، پژوهشگر ارشد در حوزه خطمشیها در بنیاد موزیلا (Mozilla Foundation)، ادغام سیستمهای هوش مصنوعی زایا در فناوریهای مصرفی، باعث بهبود تأثیرگذاری و عملکرد این فناوریها میشود. این اتفاق تأثیرات خوب و بد متفاوتی را بهدنبال خواهد داشت.

مثلاً برای آموزش تطابق کلمات و مفاهیم خاص با تصاویر خاص به سیستم هوش مصنوعی Stable Diffusion، از میلیاردها عکس موجود در اینترنت استفاده شده است. درضمن ابزار هوش مصنوعی ایجادکننده متن را میتوان بهراحتی فریب داد و آنها را به ابزاری برای ارائه نگرشهای توهینآمیز و اطلاعات گمراهکننده تبدیل کرد.

«مایک کوک» (Mike Cook) عضو گروه پژوهش باز نایوز و پینت براشیز (Knives and Paintbrushes)، در مورد اینکه هوش مصنوعی زایا در آینده زمینهساز ایجاد تغییرات اساسی (و البته مشکلآفرین) اجباری میشود، با گانتز موافق است؛ اما قبلاً گفته سرمایهگذاری برای توسعه هوش مصنوعی زایا در سال ۲۰۲۳، تنها برای بهبود وضعیت کنونی آن انجام میشود و سرمایهها صرف تحقق وعدههای دادهشده در مورد آن نمیشوند.

کوک در مورد موضوع اینچنین گفته است:

«ترغیب جامعه متخصصان هوش مصنوعی برای ایجاد فناوری جدید و تلاش آنها برای تحقیق تأثیرگذاری بلندمدت این فناوریها روی زندگی مردم، بهتنهایی کافی نیست و باید شرایط کسب درآمد سرشار از این فناوریها یا ایجاد تأثیرات محسوس آنها روی زندگی روزمره مردم را نیز فراهم کرد. بنابراین به نظرم در آینده شاهد اقدام پیشران جدیدی برای دستیابی هوش مصنوعی زایا به یکی از این دو هدف مذکور یا کسب موفقیت آن در هر دو زمینه باشیم.»

مقابله با استفاده از آثار هنری هنرمندان برای آموزش سیستمهای هوشمند مصنوعی

شبکه اجتماعی آنلاین هنرمحور دویانآرت (DeviantArt)، یک هوش مصنوعی خالق آثار هنری را بر پایه Stable Diffusion ایجاد کرده است. در اینمدل از مجموع آثار برگزیده شبکه هنری جامعه دویانآرت نیز استفاده شده است؛ اما متأسفانه اینابزار مورد حمله شدید اعضای طولانیمدت جامعه هنری دویانآرت قرار گرفت. اینهنرمندان در مورد عدم شفافیت سیستم در مورد استفاده از آثار هنری بارگذاری شده آنها در دویانآرت، برای آموزش هوش مصنوعی، شدیداً انتقاد کردهاند.

OpenAI (اوپنایآی) و Stability AI (استیبیلیتی اِیآی)، دو شرکت سازنده محبوبترین سیستمهای هوش مصنوعی کنونی یعنی ChatGPT و Stable Diffusion، اعلام کردهاند در حال انجام اقداماتی برای محدودکردن میزان محتوای آسیبزننده ایجادشده توسط این دو مدل هستند.

البته خروجیهای این دو ابزار بر مبنای بسیاری از تصاویر و متون موجود در شبکههای اجتماعی مورد قضاوت قرار میگیرند و بیشک هر دو هنوز جای کار دارند.

گانتز که در حال مقایسه بحثوجدلهای دائمی مرتبط با بازبینی محتوای شبکههای اجتماعی است، در مورد اینموضوع اینچنین گفته است:

رفع چنین مشکلاتی نیازمند جمعآوری، مدیریت و ارائه دائمی مجموعه دادهها است. چنین دادههایی ازجمله دادههای کسبشده از جوامعی که در ارائه محتوا چندان موفق نبودهاند، باید موشکافانه بررسی شوند.

شرکت Stability AI که بخش عمدهای از سرمایه موردنیاز پروژه Stable Diffusion را تأمین کرده، اخیراً در برابر فشارهای عمومی تسلیم شده است. چنین اقدامی نشان داد که شرکت مذکور اینحق را به هنرمندان داده که اجازه ندهند از آثار هنریشان که در حقیقت همان مجموعه دادهها هستند، برای آموزش نسل بعدی Stable Diffusion استفاده شود. هنرمندانی که اینحق را دارند، میتوانند تا چند هفته قبل از آغاز فرایند آموزش هوش مصنوعی با مراجعه به وبسایتی، درخواستشان را برای استفادهنشدن از آثار هنری خود برای اینکار ثبت کنند.

البته متأسفانه OpenAI چنین مکانیسم ایجاد نکرده است. اینشرکت مشارکت با شرکتهایی ارائهدهنده تصاویر باکیفیت مثل شاتر استاک (Shutterstock) بهمنظور کسب مجوز قانونی استفاده از بخشی از کلکسیون تصاویر چنین شرکتهایی برای آموزش هوش مصنوعی را به استفاده از آثار هنرمندان ترجیح داده است.

البته Stability AI با فشارها و مخالفتهای قانونی و عمومی در مورد استفاده از عموم آثار هنرمندان مواجه شده است. به همین دلیل اینشرکت نیز مدت کوتاهی قبل از آغاز فرایند آموزش هوش مصنوعی، رویکرد OpenAI را دنبال خواهد کرد. حتی ممکن است دادگاه Stability AI را وادار به انجام چنین کاری کند؛ زیرا اکنون شرکتهای مایکروسافت، گیت هاب و OpenAI به دلیل نقض قانون کپیرایت به خاطر استفاده از ابزار هوش مصنوعی کوپایلوت (Copilot)، سرویس گیت هاب با قابلیت پیشنهاد خودکار خطوط کدها، تحت پیگرد قضایی هستند. طبیعتاً امکان دارد Stability AI نیز با چنین مشکلی مواجه شود.

البته احتمالاً گیت هاب مواجهه با چالشها و مشکلات قانونی در آینده را پیشبینی کرده است و برای جلوگیری از مواجهه با چنین مشکلاتی تلاش میکند؛ زیرا اینشرکت تنظیمات جدیدی برای جلوگیری از نمایش کدهای عمومی در پیشنهادها کوپایلوت ایجاد کرده است. در ضمن یک ویژگی برای ارجاعدادن به منبع کدهای پیشنهادی نیز معرفی کرده است؛ اما چنین اقداماتی بدون عیب نیستند؛ مثلاً در یک نمونه، تنظیمات فیلترینگ باعث شدند کوپایلوت بخش عمدهای از کدهای دارای کپیرایت ازجمله کدهای موجود در متون ارجاع داده شده به فرد مؤلف یا متون دارای گواهینامه را حذف کند.

انتظار میرود در سال ۲۰۲۳ انتقادات در مورد هوش مصنوعی افزایش یابد؛ مخصوصاً در انگلستان. درضمن ممکن است قوانینی که لزوم استفاده صرفاً تجاری از سیستمهای آموزشدیده با دادههای عمومی را حذف میکنند، بهدقت و با تفکر کامل بررسی شوند.

ادامه رشد پروژههای متنباز و غیرمتمرکز هوش مصنوعی

در سال ۲۰۲۲ تنها تعداد معدودی از شرکتهای هوش مصنوعی، صحنه را در دست گرفتند که OpenAI و Stability AI مهمترین آنها بودند؛ اما انتظار میرود در سال میلادی جاری سیستمها باز هم به سمت متنباز شدن حرکت کنند. همچنین ممکن است ساخت سیستمهایی با قابلیتهایی فراتر از قابلیتهای سیستمهای هوش مصنوعی قوی کنونی با قابلیتهای متعدد، نیز امکانپذیر شود. نگرش جامعه هوش مصنوعی میتواند منجر به بررسی دقیقتر سیستمها در حین فرایند ساخت یا به کارگیری آنها شود.

گانتز در مورد اینموضوع اینچنین میگوید:

اگر مدلها متنباز و مجموعه دادهها هم باز باشند، پژوهش انتقادی به میزان بسیار بیشتری امکانپذیر میشود. ایناتفاق منجر به نمایانشدن بسیاری از اشتباهات و آسیبهای مرتبط با هوش مصنوعی زایا میشود. پیبردن به ایناشتباهات و آسیبها تا به امروز بسیار دشوار بوده است.

ایجاد مدلهای زبانی بزرگ ایجادشده توسط الوثر ایآی (EleutherAI) و بیگ ساینس (BigScience)، نمونهای از اینتلاشهای متمرکز بر جامعه هوش مصنوعی هستند. اینمدلها با پشتیبانی استارتاپ هوش مصنوعی هاگینگ فیس (Hugging Face) انجام شدهاند. EleutherAI گروه غیرمتمرکزی از پژوهشگران، مهندسان و توسعهدهندگان داوطلب متمرکز روی متوازنسازی و مقیاسگذاری هوش مصنوعی و پژوهش در مورد هوش مصنوعی متنباز است. BigScience یک گروه علمی باز پیشگام متشکل از محققان سراسر جهان با هدف همکاری برای آموزش یک سیستم زبانی بزرگ است.

در ضمن خود Stability AI هم در حال تأمین سرمایه موردنیاز تعدادی از جوامع هوش مصنوعی است. از میان اینجوامع میتوان به هارمون آیای (Harmonai)، جامعه متمرکز روی ساخت موسیقی و اوپنبیوامال (OpenBioML)، مجموعهای گسترده از آزمایشهای زیستفناوری، اشاره کرد.

داشتن سرمایه کافی و تخصص لازم هنوز هم دو اصل موردنیاز برای آموزش و راهاندازی مدلهای هوش مصنوعی پیچیده هستند؛ اما ممکن است با جوابدادن تلاشهای متنباز، مراکز داده قدیمی متداول، با فناوری محاسبه غیرمتمرکز به چالش کشیده شوند.

گروه BigScience اخیراً با انتشار پروژه متنباز پتالز (Petals)، گامی در راستای امکانپذیرکردن توسعه غیرمتمرکز، برداشت. Petals توزیع قدرت محاسباتی را برای کاربران فراهم میکند. اینپروژه عملکردی مشابه پروژه فولدینگ اتساین هوم (Folding@home) دارد. Folding@home برای راهاندازی مدلهای زبانی هوش مجموعه بزرگ طراحی شده است. استفاده از اینپروژه معمولاً نیازمند استفاده از یک پردازنده گرافیکی یا یک سرور و دوام بالا و قدرتمند است.

چاندرا باگاواتولا (Chandra Bhagavatula)، دانشمند پژوهشگر ارشد موسسه هوش مصنوعی آلن Allen، در ایمیلی در مورد آموزش و راهاندازی مدلهای مدرن هوش مصنوعی زایا، اینچنین گفت:

آموزش و راهاندازی مدلهای مدرن هوش مصنوعی زایا، از نظر محاسباتی پرهزینه است. برخی از تخمینهای غیررسمی هزینه روزانه اجرای سیستم ChatGPT را در حدود ۳ میلیون دلار برآورد کردهاند. در نظر گرفتن چنین هزینههایی، برای تداوم فعالیت اینچت بات هوش مصنوعی و گستردهکردن دسترسی به آن در آینده ضروری میشود.

به نظر باگاواتولا تا زمانی که روشها و دادههای در دسترس، اختصاصی باقی بمانند، لابراتوارهای هوش مصنوعی همچنان مزیت رقابتی خود را حفظ خواهند کرد؛ مثلاً بهتازگی OpenAI مدل پوینت- ای (Point-E) را با قابلیت ایجاد عناصر سهبعدی بر مبنای درخواستهای متنی منتشر کرده؛ اما با اینکه OpenAI مدل را متنباز کرده، از افشای منبع دادههای استفادهشده برای آموزش Point-E یا انتشار خود دادهها اجتناب کرده است.

مدل هوش مصنوعی Point-E با قابلیت ایجاد طرحهای سهبعدی بر مبنای ورودی متن

باگاواتولا در مورد اینموضوع اینچنین گفته است:

به نظر من تلاشهای متنباز و تلاشهای غیرمتمرکز، واقعاً ارزشمند نیستند و نمیتوانند برای تعداد زیادی از پژوهشگران، متخصصان حوزه هوش مصنوعی و کاربران سودمند باشند. بهترین مدلها برخلاف متنبازبودن به دلیل محدودبودن منابع آنها، هنوز برای بسیاری از پژوهشگران و متخصصان غیر قابل دسترس هستند.

تغییر رویکرد شرکتهای هوش مصنوعی در راستای تبعیت از قوانین جدید

قوانینی مثل قانون هوش مصنوعی اتحادیه اروپا (EU’s AI Act) میتوانند رویکرد شرکتهای هوش مصنوعی در مورد نحوه ایجاد و بهکارگیری سیستمهای هوش مصنوعی در آینده را تغییر دهند. بنابراین سایر قوانین هوش مصنوعی محلی مثل قانون بهکارگیری هوش مصنوعی نیز میتوانند زمینهساز چنین تغییراتی شوند.

بر اساس قانون هوش مصنوعی نیویورک، آن دسته از فناوریهای هوش مصنوعی یا فناوریهای مبتنی بر الگوریتمها که برای استخدام رسمی و استخدام قراردادی و فروش استفاده میشوند، باید قبل از استفادهشدن، ازنظر متعصبانه بودن یا نبودن، بررسی شوند.

باگاواتولا اعمال چنین قوانینی را ضروری میداند؛ خصوصاً در زمان کنونی که نقایص فنی آشکار هوش مصنوعی زایا مثل گرایش آن به ارائه حجم گستردهای از اطلاعات اشتباه، در حال افزایش هستند.

او در مورد این موضوع اینچنین میگوید:

استفاده از هوش مصنوعی زایا به دلیل داشتن نقایص فنی، در برخی از مکانها، مثل حیطههایی که اشتباهات در آنها منجر به بار آوردن هزینههای هنگفت میشوند (نظیر مراکز درمانی)، دشوار است. در ضمن سهولت ایجاد اطلاعات نادرست، منجر به ایجاد نگرانیهای در مورد دروغپراکنی و انتشار اطلاعات نادرست شده است. سیستمهای هوش مصنوعی قبلاً تصمیماتی با پیامدهای منفی اخلاقی متعدد گرفتهاند و هنوز هم شاهد چنین اتفاقاتی هستیم.

قوانین جدید حوزه هوش مصنوعی میتوانند شرکتهای فعال در اینحوزه را در سال ۲۰۲۳ به چالش بکشاند. همچنین انتظار میرود امسال شاهد بحثوجدلهای بیشتری در مورد اینقوانین باشیم. حتی ممکن است میزان برگزاری دادگاهها قبل از جریمه یا متهمشدن افراد، افزایش یابد.

البته ممکن است رقابت شرکتهای هوش مصنوعی برای کسب جایگاهی ارزشمند در سودمندترین گروههای طبقهبندیهای قانونهای آینده، در اینسال همچنان ادامه داشته باشد. گروههای «risk (پرخطر)» در طبقهبندی قانون هوش مصنوعی اتحادیه اروپا، نمونهای از اینگروهها هستند.

قوانین کنونی هوش مصنوعی، سیستمهای هوش مصنوعی را به ۴ گروه پرخطر تقسیم کردهاند. در هر یک از اینگروهها، سیستمهای هوش مصنوعی دارای ویژگیهای خاصی قرار میگیرند. در ضمن در هر گروه سیستمها در سطح متفاوتی، با دقت بالایی بررسی میشوند.

مثلاً الگوریتمهای امتیازبندی اعتبار و اپلیکیشنهای جراحی با هوش مصنوعی، در گروه سیستمهای پرخطر (high risk) قرار گرفتهاند. سیستمهای هوش مصنوعی برای کسب مجوز ورود به بازار اروپا، باید یکسری استانداردهای قانونی، اخلاقی و فنی را داشته باشند

اما سیستمهای دارای کمترین میزان خطر یا بدون خطر (minimal or no risk)، لازم نیست چنین استانداردهایی را داشته باشند. این سیستمها مثل سیستمهای فیلتر اسپمها و بازیهای کامپیوتری دارای هوش مصنوعی، تنها ملزم به رعایت شفافسازی هستند؛ مثلاً چنین سیستمهایی باید به کاربران اطلاع دهند که آنها درحال تعامل با یک سیستم هوش مصنوعی هستند.

اوس کیز (Os Keyes)، کاندیدای دکترا در دانشگاه واشنگتن در مورد تصمیم آن دسته از شرکتهای هوش مصنوعی که مصمم به استفاده از سیستمهای هوش مصنوعی دارای کمترین میزان خطر بهمنظور به حداقل رساندن مسئولیتهای خود و حضورشان در زیر ذرهبین قوانین هستند، ابراز نگرانی کرده است.

به نظر او فارغ از نگرانیهای مرتبط با هوش مصنوعی، قانون هوش مصنوعی اتحادیه اروپا، بهترین گزینه برای بازدارندگی در حوزه هوش مصنوعی است. به اعتقاد او کنگره آمریکا تقریباً هیچ قانونی برای مقابله با عواقب بد استفاده از هوش مصنوعی وضع نکرده است.

جذب سرمایههای قابلتوجه

گانتز، معتقد است حتی اگر هوش مصنوعی برای بسیاری از افراد بهاندازه کافی خوب باشد، به برخی از افراد آسیبهای عمیقی وارد میکند. به نظر او قبل از آغاز استفاده گسترده مردم از ابزارهای هوش مصنوعی یا شروع استفاده تجاری از آنها باید کارهای زیادی در اینحوزه انجام شود.

مسلماً در صورت تولید محتوای نامناسب و درهمبرهم توسط هوش مصنوعی زایا، کاربران دیگر تمایلی به استفاده از آن نخواهد داشت. در ضمن هوش مصنوعی باید برای همه کاربران محتوایی باکیفیت یکسان ارائه دهد.

هنوز مشخص نیست که آیا در سال ۲۰۲۳ شرکتهای هوش مصنوعی متقاعد به رعایت موارد مذکور خواهند شد یا نه. اینموضوع اهمیت زیادی دارد؛ بهخصوص اکنون که سرمایهگذاران متمایل به سرمایهگذاری روی هر گونه هوش مصنوعی زایای نویدبخش هستند.

شرکت Stability AI علیرغم وجود بحثهای جنجالبرانگیز در مورد Stable Diffusion، موفق به جذب سرمایه ۱۰۰ میلیون دلاری از سوی حامیان مطرحی با ارزشی بالغ بر یک میلیارد دلار شده است. از میان اینحامیها میتوان به کوتو (Coatue)، شرکت سرمایهگذاری متمرکز بر فناوری و لایتاسپید پارتنرز (lightspeed venture partners)، شرکت سرمایهگذاری خطرپذیر، اشاره کرد.

گفته میشود OpenAI در حال حاضر ۲۰ میلیارد دلار ارزش دارد. در ضمن اینشرکت برای گرفتن سرمایه بیشتر از مایکروسافت در حال رایزنیهای پیشرفته با اینشرکت است. مایکروسافت قبلاً در سال ۲۰۱۹ یک میلیارد دلار در OpenAI سرمایهگذاری کرده است؛ البته مسلماً برخی از شرکتها هم موفق به جذب سرمایه نخواهند شد.

طبق اطلاعات ارائهشده در وبسایت کرانچ بیس (crunchbase)، وبسایت ارائهدهنده اطلاعات تجاری شرکتهای خصوصی و دولتی، تقریباً تمام شرکتهای مصنوعی برتر موفق به جذب سرمایه در سال ۲۰۲۲، شرکتهای نرمافزاری هستند. تنها چهار شرکت هوش مصنوعی سختافزاری موفق به کسب چنین موفقیتی در سال ۲۰۲۲ شدند. اینشرکتها شامل سه شرکت فعال در حوزه فناوری خودران یعنی کرروز (Cruise) و ویوی (Wayve) و وی راید (WeRide) و شرکت رباتیک مگاروبو (MegaRobo) میشود.

کانتنت اسکوئر Contentsquare، شرکت فروشنده سرویس ارائهدهنده محتوای پیشنهادی هوش مصنوعیمحور برای فضای وب، در جولای ۲۰۲۲ فرایند سرمایهگذاری ۶۰۰ میلیون دلاری خود را تکمیل کرد. یونیفور (Uniphore)، شرکت فروشنده نرمافزارهای تحلیل مکالمات و دستیارهای قادر به مکالمه (برای استفاده در مکانهایی مثل مراکز تماس)، در فوریه ۲۰۲۲ سرمایهگذاری ۴۰۰ میلیون دلاری خود را انجام داد.

شرکت های اسپات (Highspot) که پلتفرم هوش مصنوعی آن توانایی ارائه پیشنهادهای جذب مشتری بازاریابی آنی داده محور را دارد، نیز در ژانویه ۲۰۲۲ دست به سرمایهگذاری ۲۴۸ میلیون دلاری زد.

ممکن است سرمایهگذاران به دنبال سرمایهگذاری در حوزههای مطمئن هوش مصنوعی باشند؛ حتی اگر چنین حوزههایی بهاندازه هوش مصنوعی زایا جذاب نباشند. از میان اینحوزهها میتوان به خودکارسازی فرایند تجزیهوتحلیل اطلاعات با هوش مصنوعی پیشرفته اشاره کرد. ایجاد بازدیدکنندگان دائمی (منظور ارجاعدادن مشتریان به یک پلتفرم فروش است) نیز حوزه بدون خطری برای سرمایهگذاری است.

هوش مصنوعی حوزهای نیست که توانایی جلب توجه سرمایهگذاران را نداشته باشد؛ اما بیشتر برای سرمایهگذاران مطرح با نفوذ و مطلع از اتفاقات احتمالی آینده دنیای فناوری مناسب است.