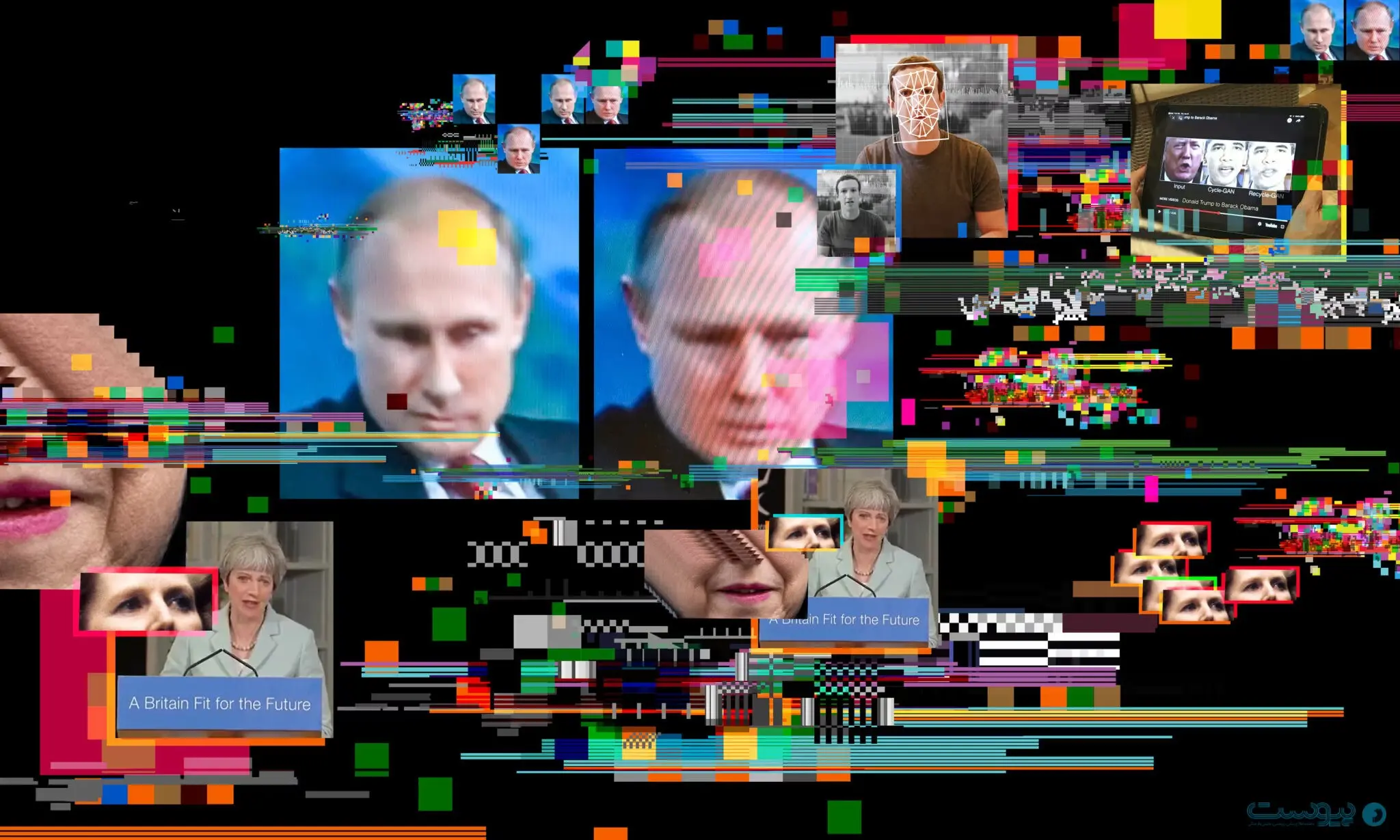

تعهد غولهای فناوری برای مبارزه با دیپفیکهای انتخاباتی

بیست شرکت بزرگ فناوری در کنفرانس امنیتی مونیخ متعهد شدند تا با همکاری یکدیگر به مبارزه با محتوای گمراهکننده هوش مصنوعی و دخالت آن در انتخاباتهای سراسر جهان بپردازند. در سال ۲۰۲۴ بسیاری از کشورهای جهان برای انتخابات آماده میشوند و محتوای صوتی و تصویری تمرکز اصلی مبارزات شرکتها است. به گفته یکی از مدیران، مغز ما به گونهای طراحی شده تا این سبک از محتوا (صوتی و تصویری) را باور کند و با وجود شهرت مولدهای متنی، انسان نگاه منتقدانهتری نسبت به متن دارد.

در این لیست نام غولهایی مثل آمازون، گوگل، متا، مایکروسافت، تیکتاک، اکس و اوپنایآی دیده میشود و شرکتها متعهد شدهاند تا با همکاری یکدیگر با تولید و انتشار محتوایی که برای گمراهکردن رایدهندگان تولید میشود مبارزه کنند. از جمله این محتواها میتوان به تصاویر، ویدیوها و صوت دیپفیک اشاره کرد.

در این تعهد داوطلبانه، که البته اولین تعهد شرکتهای فناوری نیست، ذکر شده است که توسعه سریع هوش مصنوعی «فرصتها و چالشهای تازهای برای فرایند دموکراتیک ایجاد میکند» و انتشار محتوای گمراهکننده میتواند «یکپارچگی فرایندهای الکتورال را خدشهدار کند.»

به طور کلی امضاکنندگان این محتوا را میتوان به دو دسته اصلی تولیدکنندگان مدلهای هوش مصنوعی و مالکان شبکههای اجتماعی تقسیم کرد که البته برخی از مالکان شبکههای اجتماعی مثل متا و توییتر در حال حاضر مدلهای مولدی نیز در حوزه هوش مصنوعی دارند.

براساس این توافق علاوه بر توسعه ابزارهایی در راستای شناسایی محتوای گمراهکننده، قرار است کارزارهایی برای آموزش و آگاهسازی رایدهندگان درمورد این سبک از محتوا برگزار شود و پلتفرمها در برابر انتشار آن اقدام کنند.

نیک کلگ، نماینده امور بینالملل متا، گفت: «با توجه به انتخاباتهای بزرگی که امسال برگزار میشوند، باید آنچه میتوانیم به کار گیریم تا از گمراه شدن مردم با محتوای ساخته هوش مصنوعی جلوگیری کنیم. این کار بزرگتر از هر شرکتی است و نیازمند تلاش گسترده از سوی صنعت، دولت و جامعه مدنی است.»

برد اسمیت، نایبرئیس هیات مدیره مایکروسافت، نیز افزود که شرکتها «مسئولیت دارند تا از تبدیل این ابزارها به سلاحی در انتخابات جلوگیری کنند.»

تعهد داوطلبانه شرکتها را در زمانی شاهد هستیم که نگرانی در بین قانونگذاران و متخصصان درمورد پتانسیل هوش مصنوعی در انتخاباتهای سال جاری از جمله در آمریکا، انگلستان و هند اظهار نگرانی کردهاند.

یکی از مقامات ارشد دولت هند پیش از این به شبکههای اجتماعی هشدار داده بود که براساس مقررات واضح و روشن این کشور باید با دیپفیکهای ساخته هوش مصنوعی مبارزه کنند و مسئولیت مبارزه برعهده پلتفرمها است.

از جمله راهکارهای مهم مبارزه با این سبک از محتوا میتوان به نهاننگاری یا سیستم واترمارک اشاره کرد. گوگل سیستمی به نام SynthID را برای واترمارک تصاویر هوش مصنوعی راهاندازی کرده است. شرکت متا نیز در ماه فوریه گفت تصاویر ساخته هوش مصنوعی را در اینستاگرام، فیسبوک و تردز نشانهگذاری میکند. روند نشانهگذاری در ماههای پیش رو آغاز میشود.

دانا رائو، مدیر ارشد بخش اعتماد شرکت ادوبی، یکی دیگری از امضاکنندگان این تعهد، میگوید با اینکه ابزارهای مولد متن همچون ChatGPT در بین کاربران شهرت بیشتری دارند اما شرکتها بیشتر وقت خود را صرف تصویر، ویدیو و متن و مبارزه با محتوای گمراهکننده در این حوزه میکنند زیرا مردم نگاه منتقدانهتری نسبت به متن دارند. به گفته او: «یک ارتباط احساسی با صوت، ویدیو و تصویر وجود دارد. مغز شما به گونهای تنظیم شده تا این سبک رسانه را باور کند.»

این توافق تازهترین تعهد داوطلبانه غولهای فناوری در حوزه هوش مصنوعی است. سال گذشته نیز گروههایی شامل اوپنایآی، گوگل دیپمایند و متا موافقت کردند تا مدلهای هوش مصنوعی مولد خود را برای بازبینی در اختیار موسسه امنیت هوش مصنوعی بریتانیا بگذارند.